Inteligența artificială a cunoscut un boom uriaș în ultima vreme. Toată lumea este atât de entuziasmată de această tehnologie, încât nici măcar nu realizează riscurile care ar putea apărea în viitor. În prezent, experții în inteligență artificială trag un semnal de alarmă, avertizând companiile că ar trebui să înceapă să abordeze riscurile înainte de a fi prea târziu.

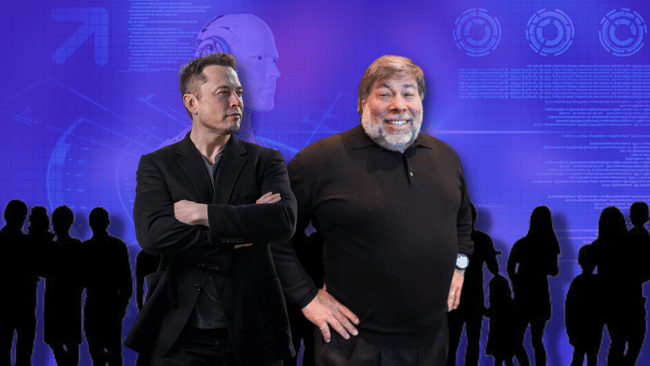

Într-o recentă scrisoare deschisă intitulată "Pauză la experimentele gigantice de inteligență artificială: o scrisoare deschisă", experții în inteligență artificială (AI) solicită companiilor care lucrează în acest domeniu să oprească temporar dezvoltarea sistemelor generative de inteligență artificială. Scrisoarea, semnată de peste 1.000 de persoane, printre care Elon Musk, Steve Wozniak, Evan Sharp, Craig Peters și Yoshua Bengio, subliniază incertitudinea cu privire la potențialul impact viitor al rezultatelor acestor dezvoltări.

În scrisoare, experții sugerează o pauză de șase luni pentru a dezvolta politici și proceduri de reglementare pentru a avansa în siguranță tehnologia IA. Pauza ar trebui să se aplice doar pentru antrenarea sistemelor de IA mai puternice decât GPT-4, modelul generativ de IA dezvoltat de OpenAI. În cazul în care apelul experților nu este ascultat, scrisoarea sugerează ca guvernele să impună un moratoriu.

Printre companiile care investesc în dezvoltarea AI generativă și a tehnologiilor conexe se numără giganți precum Microsoft $MSFT, Alphabet $GOOGL, Alibaba $BABA și Baidu $BIDU. Scrisoarea experților solicită protocoale de siguranță și asigurarea unui impact pozitiv și a posibilității de gestionare a riscurilor. Rezultatul scrisorii ar putea determina companiile fie să se oprească și să formuleze noi politici, fie cel puțin să se gândească la impactul potențial și să ia măsurile necesare.

GPT-4 ca declanșator al unor potențiale probleme

GPT-4, care a fost introdus recent, a impresionat utilizatorii cu capacitățile sale de conversație, de redactare a cântecelor și de rezumare a documentelor lungi. Reacția la acest model a determinat concurenții, cum ar fi Alphabet Inc., să accelereze dezvoltarea unor modele lingvistice similare de mari dimensiuni. Cu toate acestea, experții în inteligență artificială solicită o încetinire a dezvoltării până când vom înțelege mai bine implicațiile și potențialele daune aduse societății.

Future of Life Institute, o organizație non-profit finanțată în principal de Fundația Musk, de grupul Founders Pledge cu sediul la Londra și de Silicon Valley Community Foundation, care a publicat o scrisoare deschisă, consideră că sistemele puternice de inteligență artificială ar trebui dezvoltate doar atunci când suntem siguri că efectele lor vor fi pozitive și că riscurile lor sunt controlabile. Organizația solicită, de asemenea, crearea unui organism de reglementare care să se asigure că dezvoltarea IA servește interesului public.

Elon Musk, cofondator al OpenAI și unul dintre experții semnatari ai scrisorii, este cunoscut pentru avertismentele sale cu privire la potențialele riscuri asociate cu dezvoltarea IA. El spune că este esențial să se stabilească protocoale de securitate comune, elaborate de experți independenți, și îndeamnă dezvoltatorii să colaboreze cu factorii de decizie politică în ceea ce privește guvernanța.

Directorul executiv al OpenAI, Sam Altman, și directorii executivi ai Alphabet și Microsoft, Sundar Pichai și Satya Nadella, nu s-au numărat printre semnatarii scrisorii deschise. Cu toate acestea, scrisoarea reprezintă un pas important în direcția deschiderii unei discuții despre viitorul IA și despre potențialele riscuri pe care le prezintă aceasta.

Posibile implicații ale scrisorii

Există mai multe posibile implicații care pot apărea în urma scrisorii. Una dintre ele este că întreprinderile și instituțiile de cercetare implicate în dezvoltarea IA și-ar putea întrerupe temporar activitățile și și-ar putea regândi practicile. Acest scenariu ar permite experților și autorităților de reglementare să analizeze evoluțiile de până acum și să ia măsurile necesare pentru a asigura siguranța și durabilitatea în domeniul IA.

Alternativ, scrisoarea ar putea duce la o mai mare conștientizare a riscurilor potențiale asociate cu dezvoltarea IA și la necesitatea de a stabili protocoale de siguranță și proceduri de reglementare. Acest lucru ar permite companiilor să se concentreze mai mult pe crearea unor sisteme de IA mai sigure și mai etice, care să aibă un impact pozitiv asupra societății.

În cele din urmă, scrisoarea ar putea inspira guvernele și organizațiile internaționale să ia în considerare introducerea unor măsuri de reglementare și moratorii pentru dezvoltarea IA. Acest lucru ar garanta că dezvoltarea IA se desfășoară în conformitate cu cele mai bune interese ale societății și este gestionată astfel încât să reducă la minimum potențialele efecte negative.

Indiferent de rezultatul scrisorii deschise, este clar că dezbaterea privind siguranța și etica dezvoltării IA este din ce în ce mai urgentă. Pe măsură ce sistemele de inteligență artificială, cum ar fi GPT-4, devin din ce în ce mai omniprezente în viața de zi cu zi, este necesar să ne concentrăm asupra modului în care aceste tehnologii pot fi utilizate pentru binele societății, fără a compromite viața privată, securitatea sau interesele persoanelor.

Un exemplu care arată modul în care sistemele de inteligență artificială pot fi utilizate pentru binele public este utilizarea GPT-4 pentru a rezolva probleme de mediu, de sănătate sau economice. Pe de altă parte, este important să se ia în considerare posibilele riscuri, cum ar fi utilizarea abuzivă a tehnologiei pentru a răspândi dezinformări, a manipula opinia publică sau a spori inegalitatea în ceea ce privește accesul la tehnologie.

Scrisoarea deschisă "Pauză la experimentele gigantice de inteligență artificială" este un apel la reflecție asupra modului în care va decurge dezvoltarea inteligenței artificiale. Rămâne o întrebare dacă se poate ajunge la un consens între experți, companii și guverne. Cu toate acestea, este important ca oamenii de știință, liderii din industrie și factorii de decizie politică să se concentreze asupra colaborării pentru a găsi modalități de a asigura și reglementa dezvoltarea IA care să fie în interesul umanității.

AVERTISMENT: Nu sunt un consilier financiar, iar acest material nu reprezintă o recomandare financiară sau de investiții. Conținutul acestui material este pur informativ.